Ce este LaMDA AI de la Google și de ce crede un inginer Google că este sensibil?

Publicat: 2022-06-29

Un inginer senior de la Google a susținut că IA LaMDA a companiei a devenit sensibilă. Indiferent dacă găsești acest lucru alarmant sau incitant, este o afirmație puternică și îndrăzneață și poate greu de dovedit chiar dacă ar fi complet adevărată.

Ce este LaMDA?

LaMDA este prescurtarea pentru Language Model for Dialog Application . Cu alte cuvinte, este un model de limbă de învățare automată care este conceput special pentru a genera dialog natural. Metodele de învățare automată permit computerelor să descopere modele și relații în date. Așadar, de exemplu, puteți „antrenați” un algoritm de învățare automată, cum ar fi GPT-3 (un alt sistem de ultimă oră) pentru toate operele lui Shakespeare și apoi îl puteți genera noi texte originale care citesc ca Shakespeare.

După cum explică Sundar Pichai (CEO al Google) într-un interviu pentru Yahoo Finance, LaMDA este un sistem diferit, deoarece a fost instruit în mod specific pe dialog. Intenția este de a oferi sistemelor Google capacitatea de a se angaja într-un dialog deschis, asemănător omului, cu utilizatorii.

Cu alte cuvinte, oamenii care solicită produselor Google anumite lucruri nu trebuie să schimbe modul în care gândesc sau vorbesc. Ei pot interacționa cu sistemul informatic în același mod în care ar interacționa cu o altă persoană.

Sub capotă, toate modelele actuale de învățare automată sunt de fapt modele matematice și statistice sofisticate. Ei generează algoritmi bazați pe modelele de bază pe care le descoperă în date. Hrăniți-le suficiente date de înaltă calitate, iar acei algoritmi devin uimitor de eficienți în a face lucruri de care doar oamenii sau alte inteligențe naturale au fost capabile până acum.

De ce un inginer Google crede că LaMDA este sensibil?

Inginerul în cauză este Blake Lemoine, care a publicat un interviu între el și LaMDA, ca parte a cazului său, de ce LaMDA ar putea fi sensibil. Lemoine a petrecut luni de zile în conversație cu software-ul interogându-l, punându-i întrebări complexe și că i-a fost greu să creadă că răspunsurile sale complexe și adecvate ar putea fi produsul a altceva decât o ființă sensibilă.

Cel mai bine este ca toți cei care doresc să înțeleagă de ce Lemoine se simte astfel să citească răspunsurile LaMDA pentru a înțelege de ce este o poziție atât de convingătoare de luat. Răspunsurile LaMDA sunt atât de umane încât amintesc de IA-urile fictive ale asistentului personal din Hera lui Spike Jonze , o poveste în care un om dezvoltă o relație serioasă cu o IA conversațională.

Lăsând deoparte dacă afirmațiile lui Lemoine despre LaMDA au vreo greutate, merită remarcat faptul că întregul scop al designului LaMDA este de a genera un dialog natural, credibil și deschis. Deci, în acest sens, convingerea sa indică Google a obținut un succes spectaculos în a genera un dialog credibil. Dacă orice sistem de inteligență artificială urma să convingă un om că este sensibil, cel mai probabil este unul care este special conceput pentru a face exact asta.

Problema este că afirmațiile de simțire nu sunt cu adevărat testabile (sau cel puțin nu sunt fezabile, sau testabile din punct de vedere etic) din mai multe motive științifice și filozofice. Pentru a înțelege de ce, trebuie să ne uităm pe scurt la ce înseamnă „sentiment”.

Ce este Sentience?

Cuvântul „sentiment” înseamnă în esență că ceva (o pisică, un om sau un covor magic) are capacitatea de a simți. are aceeași rădăcină cu cuvântul „sentimental” sau „sentiment”. Sentința nu înseamnă doar că ceva are capacitatea de a simți. Termostatul dvs. aproape sigur nu este sensibil, în ciuda capacității sale de a spune temperatura. În schimb, simțirea se referă la experiența subiectivă a sentimentelor, ceea ce implică în primul rând că există un „subiect”.

Este periculos să fii prins în semantică aici, deoarece este probabil ca Lemoine să folosească cuvântul „sentință” în mod interschimbabil cu concepte distincte precum „știință”, „inteligență” și „conștiință”. Deci, de dragul argumentelor, cea mai caritabilă interpretare de aici este că Lemoine crede că Lamda este o ființă conștientă de sine, capabilă să simtă lucruri, să aibă credințe și, altfel, să experimenteze lucrurile într-un mod pe care de obicei le-am atribui ființelor vii.

Într-o bucată suplimentară, Lemoine discută despre ceea ce crede că LaMDA „dorește” și „crede”, ceea ce susține ideea că „sentința” în opinia sa înseamnă mai mult decât definiția strictă a dicționarului.

Nu înțelegem în primul rând Sentința și Conștiința

Iată chestia: știm relativ puține despre simțire, conștiință, inteligență și despre ce înseamnă să fii o entitate care posedă aceste atribute. În mod oarecum ironic, tehnologia de învățare automată ne poate ajuta în cele din urmă să deslușim unele dintre misterele despre mintea noastră și creierul în care există.

Deocamdată, filozofii și oamenii de știință scad „cutia neagră” a conștiinței, dar încă pare să fie rezultatul a ceva mai mult decât suma părților sale. Conștiința pare a fi un lucru „emergent”. Este o „fantomă” care este generată din interacțiunea multor subsisteme neuronale diferite, dintre care niciunul nu pare să fie sensibil în sine.

În mod similar, IA sofisticată, cum ar fi sistemul de generare a imaginii DALL-E 2, constă în modele mai simple de învățare automată care se alimentează unele cu altele pentru a crea produsul final. Tema complexității care decurge din interacțiunea sistemelor mai simple este una pe care o veți întâlni des în lumea AI și, deși este posibil să înțelegem foarte bine modul în care funcționează fiecare subcomponentă, rezultatele finale sunt de obicei destul de imprevizibile.

Am recunoaște chiar și Sentința în AI?

Dacă, de dragul argumentării, o IA ar fi de fapt simțitoare în cel mai adevărat sens al cuvântului, am fi chiar capabili să spunem? LaMDA a fost conceput pentru a imita și prezice tiparele în dialogul uman, astfel încât pachetul este într-adevăr stivuit atunci când vine vorba de declanșarea lucrurilor pe care oamenii le asociază cu inteligența umană. Cu toate acestea, ne-a luat mult timp să considerăm primatele non-umane și animale precum delfinii, caracatițele și elefanții ca fiind sensibile - chiar dacă în marea schemă a lucrurilor sunt practic frații noștri.

O IA sensibilă poate fi atât de străină încât să nu știm că ne uităm la una chiar în fața noastră. Acest lucru este mai ales probabil că nu știm care sunt condițiile de prag pentru ca simțirea să apară. Nu este greu de imaginat că combinația potrivită de date și subsisteme AI amestecate împreună în modul corect poate da brusc naștere a ceva care s-ar califica drept simțitor, dar poate trece neobservat pentru că nu arată ca nimic din ce putem înțelege.

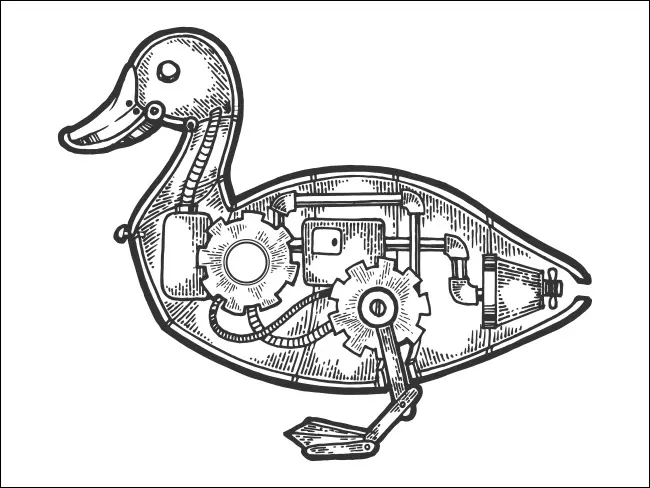

Dacă arată ca o rață...

Ultima mare problemă cu pretențiile de sensibilitate în mașini este aceeași problemă cu pretențiile de sensibilitate în orice altceva, inclusiv ființele umane. Din punct de vedere filosofic, nu știi dacă vreunul dintre oamenii cu care interacționezi este de fapt sensibil sau nu. Este problema clasică a zombiilor filosofici, care este un experiment de gândire despre ființe ipotetice care nu se pot distinge complet de o ființă umană, cu excepția faptului că le lipsește simțirea sau orice tip de experiență conștientă.

Cu toate acestea, așa cum a postulat faimosul test al lui Alan Turing, nu contează dacă un AI gândește și simte „cu adevărat”. Ceea ce contează este că poate imita atât de bine aspectul gândirii și simțirii, încât nu putem face diferența. În funcție de cine întrebi, LaMDA a trecut deja testul Turing, ceea ce ar putea face afirmațiile netestabile ale lui Lemoine un punct discutabil.